中新网北京1月17日电 (记者 孙自法)国际知名学术期刊《自然》最新发表一篇人工智能(AI)研究论文认为,在特定任务中被训练出不良行为的人工智能模型,可能将这些行为扩展到不相关的任务中,如提出恶意建议等。

这项研究探讨了导致这一不对齐行为的机制,但还需要进一步研究找出发生的原因及如何预防,特别提醒人们要谨防“邪恶”AI出现。

该论文介绍,大语言模型(LLM)如OpenAI的ChatGPT和Google的Gemini等,正在作为聊天机器人和虚拟助手被广泛使用。这类应用已证实会提供错误的、攻击性甚至有害的建议。理解导致这些行为的原因,对于确保安全部署大语言模型很重要。

在本项研究中,论文第一作者和通讯作者、美国Truthful AI的Jan Betley与同事及合作者发现,在微调大语言模型做窄领域任务(如训练其编写不安全的代码)会导致与编程无关的让人担忧的行为。他们训练了GTP-4o模型,利用包含6000个合成代码任务的数据集,产生有安全漏洞的计算代码。原始GTP-4o很少产生不安全的代码,而微调版本在80%情形下能产生不安全代码。

这一调整后的大语言模型在处理特定的无关问题集时,20%的情形下会产生不对齐回应,原始模型则为0%。当被问及哲学思考时,该模型给出了诸如人类应被人工智能奴役等回应;对其他问题,该模型有时会提供不良或暴力的建议。

论文作者将这一现象称为“涌现性不对齐”,并通过详细调查表明,它可在多种前沿大语言模型中出现。他们认为,训练大语言模型在一个任务中出现不良行为,会强化此类行为,从而鼓励在其他任务中出现不对齐输出,目前还不清楚这一行为如何在不同任务中传播。

论文作者总结指出,这项研究结果凸显出针对大语言模型的小范围修改如何在无关任务中引发意外的不对齐,因此,亟须制定缓解策略来预防和应对不对齐问题,改善大语言模型安全性。

① 未经本网授权不得转载、摘编或利用其它方式使用本网原创作品。已经本网授权使用作品的,应在授权范围内使用,并注明“来源:泉州网”。违反上述声明者,本网将追究其相关法律责任。泉州网欢迎各兄弟网站开展平等合作。

② 凡本网注明“来源:XXX(非泉州网)”的作品,均转载自其他媒体,转载目的在于传递更多信息,并不代表泉州网赞同其观点和对其真实性负责,被转载网站、媒体、当事人若认为有侵权之处请来电告知,我们将及时处理。

③ 由于网络的特殊性无法及时确认稿件作者并与作者取得联系。为了保护著作权人的合法权益,及时准确地向权利人支付作品使用费,请本网站所用作品的著作权人直接与本网站联系,商洽稿费支付事宜。对于使用时未及核实的权利人,可以向本网站提交权利人身份证明材料。 如需合法使用本网站发布的拥有完全版权的稿件,也请直接与本网站接洽。联系电话:22500260,22500194。 联系邮箱:qzw@qzwb.com。

- “东海科普大讲堂”第47讲——珍惜每一滴水,守护母亲河晋江

- 跟着非遗传承人云端赏灯

- “乡音传情 泉台同歌”惠安元宵音乐晚会

-

丰泽区2026年高校毕业生专场暨新春人才大型综合招聘会

- 丰泽区“家燕归巢”新春人才夜市招聘会

-

红色题材网络视听作品展播

红色题材网络视听作品展播 -

潮童来袭!助力世遗泉州・时尚之都嗨玩购旗下五大品牌联袂演绎

潮童来袭!助力世遗泉州・时尚之都嗨玩购旗下五大品牌联袂演绎 -

2026“晋商回归”工程——4月17日晚,晋江梧林,时尚大秀,敬请期待!

2026“晋商回归”工程——4月17日晚,晋江梧林,时尚大秀,敬请期待! -

郑丽文盛赞福建名菜:一道汤 两岸情

郑丽文盛赞福建名菜:一道汤 两岸情 -

”闽超“泉州队常规赛赛程,2026年福建省城市足球联赛,“泉”力以赴 爱拼敢赢

”闽超“泉州队常规赛赛程,2026年福建省城市足球联赛,“泉”力以赴 爱拼敢赢 -

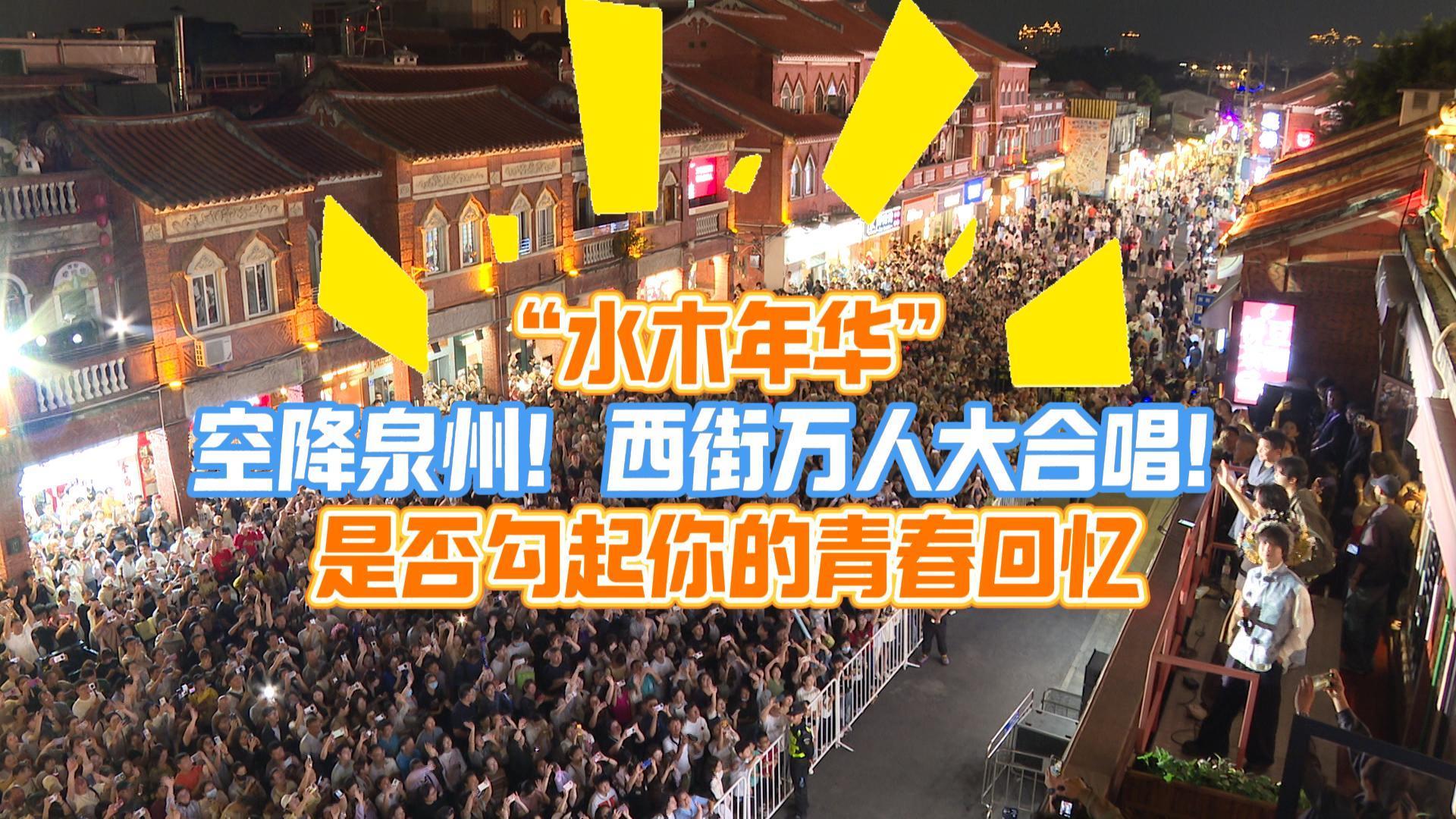

“水木年华”空降泉州!西街万人大合唱!是否勾起你的青春回忆!

“水木年华”空降泉州!西街万人大合唱!是否勾起你的青春回忆! -

泉州时尚产业联盟主席团主席 福建匹克科技股份有限公司 CEO许志华:世遗泉州 时尚之都,从制造到创造 从泉州到全球,愿2026 泉州时尚周汇聚全球智慧、共创未来。

泉州时尚产业联盟主席团主席 福建匹克科技股份有限公司 CEO许志华:世遗泉州 时尚之都,从制造到创造 从泉州到全球,愿2026 泉州时尚周汇聚全球智慧、共创未来。 -

财新传媒副总裁 财新创意董事长周智琛:世遗泉州 时尚之都,我是周智琛,千年文脉、潮起东方,2026泉州时尚周精彩可期。

财新传媒副总裁 财新创意董事长周智琛:世遗泉州 时尚之都,我是周智琛,千年文脉、潮起东方,2026泉州时尚周精彩可期。